Dlaczego programiści i DevOps potrzebują AI – kontekst, nie hype

Mit o tym, że AI zabierze pracę programistom

Najgłośniejszy mit brzmi: „AI zabierze pracę programistom i zespołom DevOps”. Rzeczywistość jest dużo bardziej prozaiczna – AI podmienia charakter pracy, a nie sam fakt jej istnienia. Znikają zadania żmudne, manualne, o niskiej wartości dodanej. Własne kompetencje kieruje się w stronę projektowania rozwiązań, oceny jakości, decyzji architektonicznych i łączenia wielu narzędzi w spójny proces.

Programista korzystający z AI rzadziej klepie „boilerplate” i schematyczny kod. Częściej opisuje, co ma powstać, weryfikuje podpowiedzi modelu i decyduje, które fragmenty są do przyjęcia, a które trzeba wyrzucić. Podobnie DevOps – zamiast ręcznie składać kolejne warianty tego samego pliku pipeline, coraz częściej iteruje: generuje szkic z pomocą AI, doprecyzowuje i testuje w kontrolowanym środowisku.

Paradoksalnie, osoby ignorujące AI nie bronią swojej pracy. Raczej oddają przewagę tym, którzy używają narzędzi mądrze – jak dobrze opanowanego IDE czy lintersów. Zmienia się profil roli: z „ręcznego wytwórcy” na operatora systemu zasilanego AI, który potrafi ocenić skutki, ryzyko i jakość.

Gadżety AI kontra narzędzia realnie skracające czas

Rynek jest zalany „magicznie inteligentnymi” narzędziami. Część z nich to marketingowy gadżet: UI nałożone na to samo API modelu, bez przemyślanej integracji z procesem. W praktyce przydają się rozwiązania, które:

- integrują się z istniejącymi narzędziami (IDE, Git, system CI/CD),

- pozwalają dodać kontekst projektu – repozytorium, konwencje, reguły jakości,

- mają sensowny model uprawnień i ślad audytowy (kto i jak użył AI),

- pozwalają łatwo porównać pracę „z AI” i „bez AI” na konkretnych metrykach.

Dobry test: jeśli po kilku tygodniach ekipa nie potrafi pokazać, co realnie przyspieszyło się dzięki AI (czasy code review, średnia długość life-cycle PR, MTTR dla incydentów), to najpewniej wdrożono gadżet, a nie narzędzie.

Obszary, w których AI naprawdę się broni

W realnych zespołach programistycznych i DevOps AI sprawdza się przede wszystkim tam, gdzie pojawia się powtarzalność i hałas informacyjny:

- Generowanie szkieletów kodu – klasy DTO, proste adaptery HTTP, szablony handlerów w API, podstawowe testy jednostkowe.

- Refaktoryzacja drobnicy – wydzielanie funkcji, upraszczanie zagnieżdżonych warunków, konwersje między wzorcami kodu.

- Szablony pipeline’ów CI/CD – główne kroki, struktury jobów, podstawowe zależności.

- Analiza logów i alertów – streszczanie długich logów, grupowanie powtarzających się zdarzeń, tworzenie hipotez źródła problemu.

- Wstępne code review – wskazywanie oczywistych błędów, potencjalnych problemów bezpieczeństwa, naruszeń konwencji.

To wszystko są czynności, które nadal wymagają decyzji człowieka, ale ich „brudna robota” zostaje znacząco skrócona. Zespół zyskuje czas na właściwe inżynierowanie, a nie mechaniczne czynności wokół kodu.

Ograniczenia: jakość danych, halucynacje i odpowiedzialność

Modele generatywne korzystają z prawdopodobieństwa, nie z pewności. Dlatego:

- halucynacje – zmyślone klasy, metody, komendy CLI, nieistniejące opcje konfiguracji – są normą, nie wyjątkiem,

- modele potrafią być przekonujące w błędzie – językowo poprawne, lecz merytorycznie fałszywe sugestie,

- jakość odpowiedzi mocno zależy od kontekstu, który dostanie model – jeśli jest za mały lub nieprecyzyjny, efekt będzie losowy.

Dlatego odpowiedzialność za kod i infrastrukturę zawsze zostaje po stronie człowieka. AI to kalkulator, który bywa zawyżającym i zaokrąglającym po swojemu. Rozsądne zespoły mają jasne zasady: kto zatwierdza zmiany wygenerowane przez AI, jakie testy są wymagane, jakie obszary są „no-go” dla automatycznej generacji.

Gdy eksperyment z AI marnuje czas całego zespołu

Historia z praktyki: kilkuosobowy zespół DevOps postanowił „wrzucić AI do procesu CI/CD”. Przez tydzień część ekipy eksperymentowała z generowaniem plików pipeline’ów w różnych narzędziach, bez zdefiniowanego celu, KPI ani obszaru, który ma się poprawić. Zamiast mierzyć skrócenie czasu konfiguracji, przerabiali te same przykłady w wielu narzędziach i dyskutowali o „fajności” funkcji.

Rezultat: żadnego trwałego artefaktu, zero wiedzy dla reszty organizacji, stracony czas sprintu. Jedyny zysk – intuicyjne poczucie, że „coś tam AI umie”. Ten scenariusz dobrze pokazuje, że bez wyraźnego celu i mierników AI bardzo szybko zamienia się w zabawkę. Dlatego pierwszym krokiem jest wskazanie konkretnych, mierzalnych zadań, a dopiero później wybór narzędzia.

Jak wybrać obszary pod automatyzację z AI – od mapy zadań do priorytetów

Inwentaryzacja rutynowych czynności programisty i DevOps

Zanim AI wjedzie w proces, trzeba zrozumieć, gdzie faktycznie powstaje tarcie. Pomaga prosta inwentaryzacja: przez 1–2 tygodnie zapisywać typowe zadania, które powtarzają się w zespole. Bez oceniania, tylko zbieranie danych.

Dla programistów lista często zawiera:

- tworzenie nowych endpointów o podobnej strukturze,

- pisanie testów jednostkowych do prostych funkcji,

- uzupełnianie dokumentacji w formacie Markdown/OpenAPI,

- przeglądanie logów aplikacji przy prostych błędach,

- rozwiązywanie powtarzających się konfliktów merge’owania.

Dla DevOps/Platform Engineer zwykle pojawiają się:

- modyfikacje podobnych plików pipeline (dodaj krok X, zmień warunek Y),

- dodawanie kolejnych serwisów do istniejącej infrastruktury IaC,

- diagnoza standardowych awarii: brak miejsca na dysku, crashloop podów, błędy konfiguracji TLS,

- przegląd alertów, które stale okazują się „false positive” lub niskiego priorytetu,

- ręczne tworzenie raportów z incydentów na podstawie logów i ticketów.

Taka lista to fundament wyboru obszarów, gdzie automatyzacja z AI ma sens. Bez niej łatwo skoncentrować się na tym, co jest modne, zamiast na tym, co naprawdę zjada czas.

Kryteria wyboru zadań: częstotliwość, ryzyko, mierzalność

Z zebranej listy warto wybrać 3–5 zadań, które:

- występują często (co najmniej kilka razy w tygodniu),

- są wyraźnie powtarzalne lub szablonowe,

- mają relatywnie niskie ryzyko biznesowe,

- łatwo zmierzyć ich czas trwania/efektywność.

Przykładowo, dobrym kandydatem jest „dodanie nowego joba do pipeline’u GitLab CI na wzór istniejącego” – zadanie często powtarzalne, z jasnym rezultatem i krótkim cyklem weryfikacji. Słabym kandydatem jest „zaprojektowanie architektury krytycznego systemu płatności” – tam AI może co najwyżej podrzucić inspiracje, ale nie będzie narzędziem automatyzującym.

Bezpieczny start: generowanie szkieletów i prosty refactoring

Na początek najlepiej wybrać zadania, gdzie AI generuje szkic, a nie pełne rozwiązanie. Sprawdzają się szczególnie:

- szablony klas i modułów – np. nowy handler w frameworku webowym, nowy command w CLI, nowa integracja z API,

- proste testy jednostkowe – wygenerowanie testów typu „happy path + kilka edge case’ów” dla czysto funkcyjnych fragmentów kodu,

- szkielet pipeline’u – budowanie, test, deploy na środowisko testowe,

- prosty refactoring – rozbijanie zbyt długich funkcji, nadawanie lepszych nazw, usuwanie duplikacji.

W tych zadaniach programista/DevOps łatwo zauważy błąd, a efekt można szybko porównać z obecnym stylem pracy. To ogranicza ryzyko, a jednocześnie pokazuje realne oszczędności czasu.

Zadania „no-go” na początek przygody z AI

Są też obszary, w które nie ma sensu wchodzić na pierwszym etapie użycia AI:

- kryptografia, bezpieczeństwo aplikacji – generowanie algorytmów kryptograficznych, własnych protokołów, złożonych polityk uprawnień,

- skomplikowane migracje danych – wieloetapowe zmiany schematu, krytyczne migracje na dużych wolumenach danych,

- kluczowe elementy architektury – decydujące o spójności, skalowalności i odporności systemu,

- obszary objęte ścisłym compliance (np. regulacje finansowe, medyczne) – bez wcześniej zdefiniowanych guard-rails.

AI może być pomocne w researchu, streszczaniu dokumentacji czy budowaniu checklist, ale nie powinno „prowadzić” tych zmian samodzielnie.

Właściciele eksperymentów i terminy oceny efektów

Aby eksperyment z AI nie zamienił się w wolną amerykankę, każde wybrane zadanie powinno mieć:

- właściciela (konkretną osobę z zespołu),

- zakres pilotażu (np. „wszystkie nowe endpointy usług X i Y w kolejnym sprincie”),

- metryki sukcesu (czas wykonania, liczba błędów wychwyconych w review, liczba rollbacków),

- termin oceny (np. na koniec sprintu / miesiąca).

Właściciel nie musi być „guru AI” – ważniejsze, by potrafił krytycznie patrzeć na efekty. Tak zebrane doświadczenia można potem opisać jako wewnętrzny „playbook AI” zespołu. W wielu firmach wskazanie takiego „championa AI” w każdym zespole przyspiesza uczenie się całej organizacji.

Podstawy pracy z modelami AI – od promptu do asystenta zespołu

Typy narzędzi AI przydatnych w pracy programisty i DevOps

Ekosystem narzędzi jest szeroki, ale można go uporządkować w kilka praktycznych kategorii:

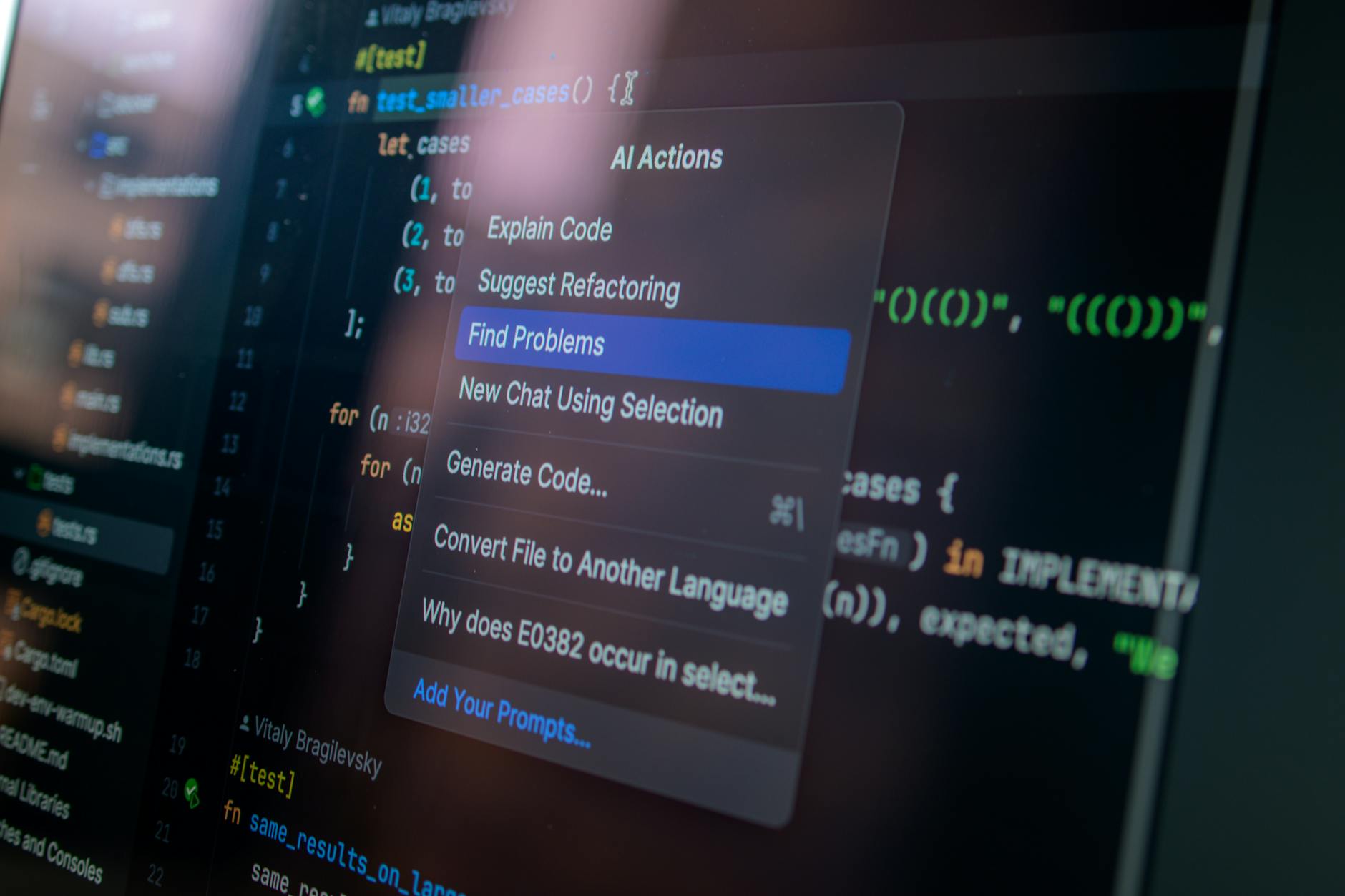

- czatowe LLM – ogólne modele konwersacyjne (np. dostępne w przeglądarce lub przez API), przydatne do debugowania, wyjaśniania błędów, researchu i generowania przykładowych fragmentów kodu,

- wtyczki IDE – asystenci dopisujący kod na podstawie kontekstu pliku i repozytorium, podpowiadający testy lub refactoringi,

- usługi w chmurze (API) – dające możliwość zintegrowania modeli z własnymi narzędziami, np. botami Slack/Teams, niestandardowymi dashboardami czy systemem ticketowym,

- narzędzia wyspecjalizowane – skanery bezpieczeństwa z AI, inteligentne przeglądarki logów, systemy AIOps do korelacji alertów.

Mit, że „wystarczy jedno narzędzie AI do wszystkiego”, szybko rozpada się w zderzeniu z rzeczywistością: wygodny asystent w IDE nie zastąpi analizy logów z danymi o ruchu produkcyjnym, a ogólny czat LLM nie przejmie roli skanera bezpieczeństwa podpiętego do CI/CD.

Dlaczego „wystarczy napisać prompt” to błędne podejście

Popularne hasło brzmi: „AI działa, wystarczy napisać prompt”. To półprawda. Pierwsza odpowiedź modelu bywa użyteczna tylko przy bardzo prostych zadaniach. W realnych przypadkach liczy się:

- kontekst – fragment repozytorium, opis środowiska, wersje technologii, ograniczenia biznesowe,

- iterowanie – doprecyzowywanie pytań, zawężanie zakresu, proszenie o alternatywne rozwiązania,

- format wyjścia – kod, który da się wkleić, lista kroków, tabela porównawcza, reguły dla CI/CD.

Różnica między „AI nic nie potrafi” a „AI realnie przyspiesza” często wynika nie z jakości narzędzia, lecz z jakości zadania. Dobrze zbudowane prompty i konsekwentne iterowanie sprawiają, że ten sam model zaczyna wyglądać jak inny produkt.

Warto też podejrzeć, jak ten temat rozwija Mebleka — znajdziesz tam więcej inspiracji i praktycznych wskazówek.

Zasady skutecznego promptu dla programisty i DevOps

W praktyce pomaga kilka prostych reguł budowania promptów:

Praktyczny szablon promptu dla zadań technicznych

Łatwo zgubić się w „prompt engineeringu”, dlatego pomaga prosty, powtarzalny szablon. Można go stosować niemal do każdego zadania technicznego:

- Rola – do kogo mówisz: „działaj jak senior backend developer w Pythonie”, „jesteś inżynierem SRE utrzymującym Kubernetes”.

- Kontekst – fragmenty kodu, opis systemu, wersje narzędzi, istotne ograniczenia.

- Cel – jedno zdanie: co ma powstać lub jaki problem ma zostać rozwiązany.

- Zakres – co ma zrobić model, a czego nie powinien robić.

- Format wyjścia – np. „jedna funkcja w Go”, „yaml gotowy do wklejenia do GitLab CI”, „lista kroków numerowana”.

Przykład przy prostej automatyzacji DevOps:

Jesteś inżynierem DevOps pracującym z GitLab CI i Dockerem.

Kontekst:

- budujemy aplikację Node.js

- chcemy cache'ować zależności npm

- pipeline ma mieć etapy: build, test

Cel:

Zaproponuj minimalny plik .gitlab-ci.yml do zbudowania i przetestowania aplikacji.

Zakres:

- użyj oficjalnych obrazów

- nie konfiguruj deployu

- załóż, że testy uruchamiamy komendą "npm test"

Format:

Podaj tylko kompletny plik .gitlab-ci.yml bez komentarzy.Różnica między suchym „napisz .gitlab-ci.yml do Node.js” a tak zdefiniowanym promptem jest ogromna. Mit, że „AI samo się domyśli”, zwykle kończy się irytacją i poczuciem, że narzędzie jest bezużyteczne.

Iteracyjne doprecyzowywanie – mini feedback loop

Jednorazowy prompt to rzadko koniec pracy. Skuteczniejsze podejście przypomina mini sprint:

- najpierw prosisz o rozwiązanie w najszerszej formie (np. kilka wariantów),

- potem zawężasz – „wersja 2 jest najbliżej, usuń krok X i uprość Y”,

- na końcu dopinasz szczegóły – format, konwencje nazewnicze, integrację z istniejącym kodem.

Przy zadaniu „wygeneruj testy jednostkowe” często sensowniejsze jest poproszenie najpierw o listę przypadków testowych z opisem w języku naturalnym, a dopiero potem o kod testów. Zysk: łatwiej wyłapać brakujące scenariusze, zanim zacznie się kopiować gotowy kod do repozytorium.

Mit: „dobre prompty pisze się od razu idealnie”. W praktyce prompty dojrzewają tak jak kod – przez refactoring i iteracje między członkami zespołu.

Udostępnianie promptów jak snippetów w zespole

Prompty, które faktycznie działają, warto traktować jak fragmenty infrastruktury zespołowej. Zamiast trzymać je w głowie:

- wrzuć je do repo jako

PROMPTS.mdz podziałem na kategorie (kod, testy, CI/CD, logi), - dodaj przykłady wejść/wyjść, by nowa osoba w zespole od razu widziała, czego się spodziewać,

- opisuj ograniczenia – np. „dobrze działa dla małych modułów, przy plikach >500 linii model zaczyna gubić kontekst”.

Dzięki temu przestają się powtarzać te same eksperymenty robione po cichu przez różne osoby. Pojawia się też wspólny język do rozmowy o AI: „użyj promptu P3 z małą zmianą kontekstu pod nasz projekt”.

Od „czatu” do asystenta zespołu – integracja z narzędziami

Ręczne wklejanie logów lub kawałków kodu do okienka czatu ma sens na początku, lecz szybko staje się wąskim gardłem. Dużo większą dźwignię daje osadzenie modeli AI w istniejących narzędziach zespołu:

- boty w Slack/Teams – podpinane do repozytoriów lub systemów monitoringu, umiejące odpowiadać na pytania „co się zmieniło w ostatnim deployu?” czy „dlaczego wzrosła liczba błędów 500?”.

- hooki w systemach ticketowych – generowanie szkiców opisów incydentów, propozycji kroków naprawczych lub streszczeń długich wątków.

- usługi API – które zespoły mogą wykorzystać w wewnętrznych narzędziach, np. do automatycznej klasyfikacji alertów.

Rzeczywistość jest taka, że dopóki AI jest „dodatkowym oknem w przeglądarce”, trudno mówić o realnej automatyzacji. Zmiana następuje dopiero wtedy, gdy AI zaczyna reagować na realne zdarzenia w systemie: push do repozytorium, nowy alert, nowy ticket.

AI jako asystent programisty – generowanie i refaktoryzacja kodu

Generowanie nowego kodu – gdzie ma sens, a gdzie szkodzi

Generowanie całych modułów aplikacji brzmi kusząco, ale nie w każdym miejscu daje korzyść. Dobrze sprawdza się w:

- powtarzalnych endpointach CRUD,

- adapterach integracyjnych (np. klient REST/GraphQL do zewnętrznego API),

- mapperach DTO ↔ model domenowy,

- prostych narzędziach CLI, skryptach pomocniczych.

W tych obszarach struktura jest przewidywalna, a programista łatwo weryfikuje poprawność. AI przyspiesza nudną część, a człowiek dobiera szczegóły biznesowe i dba o spójność z istniejącą architekturą.

Z kolei generowanie skomplikowanych fragmentów logiki domenowej lub warstwy bezpieczeństwa (np. własny system uprawnień) często kończy się nadmiarem kodu, trudnego potem w utrzymaniu. Mit: „AI wreszcie napisze za nas skomplikowaną logikę biznesową”. Rzeczywistość: wygeneruje coś, co wygląda imponująco, ale jest pełne założeń niezgodnych z rzeczywistością systemu.

Technika „skeleton + uzupełnienie”

Zamiast prosić model o „napisanie całej klasy serwisu”, lepiej wykorzystać go do stworzenia szkieletu:

Dobrym uzupełnieniem będzie też materiał: Jak zbudować portfolio na GitHubie dzięki sensownym kontrybucjom — warto go przejrzeć w kontekście powyższych wskazówek.

- interfejsów,

- podpisów metod,

- podstawowej obsługi błędów,

- logowania i walidacji wejść.

Następnie programista dopisuje logikę domenową, zwykle znacznie szybciej niż przy tworzeniu wszystkiego od zera. Ten sposób minimalizuje „halucynacje biznesowe” – AI nie wymyśla zachowań, których nie było w wymaganiach, bo nie dotyka najbardziej wrażliwej części.

Refaktoryzacja z AI – jak zyskać, nie tracąc kontroli

Refaktoryzacja to naturalne pole do automatyzacji. Kilka typów zadań, gdzie modele radzą sobie zaskakująco dobrze:

- rozbijanie dużych funkcji na mniejsze, o sensownych nazwach,

- usuwanie powtórzeń – wyciąganie wspólnego kodu do helperów,

- konwersje stylu – np. z callbacków na async/await, z klas na funkcje, z jednego frameworka testowego na inny,

- dodawanie typów (TypeScript, mypy w Pythonie) na podstawie istniejącego kodu.

Bezpieczna praktyka to ograniczanie pojedynczego refaktoryzowanego fragmentu – zamiast „popraw cały moduł”, proś o zmiany w jednym pliku lub grupie blisko powiązanych funkcji. Łatwiej wtedy zrobić review i zrozumieć, dlaczego powstała taka, a nie inna propozycja.

Dobrze sprawdza się też podejście „zapytaj o refactoring bez generowania kodu”: najpierw poprosić model o opis kroków refaktoryzacji i uzasadnienie, a dopiero potem o kod. Wymusza to myślenie architektoniczne, a nie ślepe kopiowanie.

Konwersja między językami i frameworkami

Migracje technologiczne bywają bolesne. AI pomaga przy:

- jednorazowej konwersji mniejszych modułów między językami (np. Python → Go dla narzędzia CLI),

- przepisywaniu prostych komponentów frontendu między frameworkami,

- mapowaniu bibliotek – „jakie odpowiedniki klasy X w bibliotece A znajdę w bibliotece B?”.

Kluczowe jest, by traktować wygenerowany kod jako szkic do przepisania, a nie jako gotową migrację 1:1. Modele świetnie wychwytują podobieństwa wzorców, ale często ignorują niuanse wydajnościowe i semantyczne między środowiskami wykonawczymi.

AI a testy jednostkowe i integracyjne

Przy testach jednostkowych AI jest szczególnie użyteczne:

- do generowania „happy path” i typowych edge case’ów,

- do uzupełniania brakujących asercji,

- do sugestii reorganizacji zestawów testów – np. grupowanie wg scenariuszy zamiast wg metod.

Dobry wzorzec: najpierw napisać funkcję ręcznie, potem poprosić model o listę możliwych błędnych wejść i wygenerowanie do nich testów. Programista wybiera, które przypadki mają sens biznesowy, a które są sztuczne.

Przy testach integracyjnych modele bardziej pomagają w pisaniu konfiguracji (docker-compose, pipeline’y uruchamiające testy) niż w samym kodzie testów. Konfiguracje są szablonowe, a potencjalne błędy stosunkowo łatwo wytropić.

Współpraca z AI podczas code review

Asystent w repozytorium może pełnić rolę dodatkowego recenzenta:

- wskazywać nieużywane zmienne, dead code, oczywiste bugi,

- flagować odstępstwa od stylu i konwencji nazewniczych,

- proponować uproszczenia warunków i pętli.

Rozsądne wykorzystanie polega na traktowaniu komentarzy AI jako „warstwy 0” review. Człowiek skupia się wtedy na spójności domenowej i ryzykach architektonicznych, a nie na drobnicy stylistycznej. Mit, że „AI zastąpi reviewerów”, kłóci się z praktyką – najlepsze efekty są wtedy, gdy AI oczyszcza pole z prostych tematów.

Automatyzacja zadań DevOps z AI – CI/CD, infrastruktura, obserwowalność

Budowa i utrzymanie pipeline’ów CI/CD

Konfiguracje pipeline’ów często rosną latami. Pojawiają się duplikaty, martwe joby, nieużywane artefakty. AI pomaga:

- przeglądać istniejący plik YAML i wskazywać duplikacje kroków,

- proponować wyciągnięcie wspólnych fragmentów do template’ów,

- tworzyć „złote szablony” pipeline’ów dla powtarzających się typów usług.

W praktyce sensowne jest podejście: „wrzuć aktualny pipeline, poproś o sugestie uproszczeń wraz z uzasadnieniem”. Dopiero później wygeneruj nową wersję pliku i porównaj linia po linii w MR/PR. Surowe „przepisz to na lepsze” bez zrozumienia może skończyć się trudnym do debugowania potworkiem.

Infrastruktura jako kod – generowanie i porządkowanie IaC

Terraform, CloudFormation, Pulumi – wszędzie tam AI może:

- generować szkielety zasobów (np. standardowy VPC, S3 z polityką, grupy bezpieczeństwa),

- pomagać przy migracji między dostawcami (np. AWS → Azure) na poziomie pojedynczych modułów,

- wykrywać powtarzające się bloki, które warto zamienić na moduły.

Przy pracy z IaC dobrą praktyką jest dołączanie do promptu:

- aktualnego modułu lub pliku,

- krótkiego „policy” zespołu – np. nazewnictwo zasobów, konwencje tagów,

- ograniczeń bezpieczeństwa (np. brak publicznych bucketów, brak otwartych portów >1024).

Model zaczyna wtedy działać jak „linter na sterydach”, a nie generator przypadkowej infrastruktury. Zmniejsza się też ryzyko, że zaproponuje rozwiązanie niezgodne z polityką organizacji.

Automatyczna diagnoza typowych awarii

W wielu zespołach SRE/DevOps 80% incydentów to powtarzalne problemy: brak miejsca na dysku, źle skonfigurowane limity CPU/RAM, nieudane rollouty. AI można wykorzystać do:

- analizy logów z kilku źródeł i streszczenia „co się wydarzyło w ciągu ostatnich 10 minut przed awarią”,

- kategoryzacji incydentów na podstawie opisu i logów,

- proponowania check-listy diagnostycznej na podstawie typu błędu.

Szczególnie przydaje się przy nocnych incydentach, gdy osoba on-call nie zna dobrze danego systemu. Skrócenie czasu od „co to w ogóle jest?” do „wiem, gdzie patrzeć” bywa bardziej wartościowe niż automatyczne „samoleczenie” systemu.

Obserwowalność i praca z logami, metrykami, trace’ami

Platformy APM i log managementu generują masę danych, których nikt nie czyta w całości. Kilka praktycznych zastosowań AI:

- grupowanie podobnych logów w „wzorce” i szacowanie, które z nich są nowe po ostatnim deployu,

Mapowanie metryk na kontekst biznesowy

Same liczby z Prometheusa czy Datadoga niewiele mówią, jeśli nie ma do nich kontekstu. Modele dobrze sprawdzają się jako „warstwa opisowa” nad surowymi danymi. Typowy schemat:

- eksportujesz wycinek metryk z danego okna czasu (np. przed i po deployu),

- dołączasz krótki opis zmian, które trafiły na produkcję,

- prosisz o opis zależności typu „które metryki zmieniły się w sposób spójny z raportowanym spadkiem konwersji / wzrostem błędów?”.

Model nie jest narzędziem do analizy statystycznej, ale jest niezłym sparingpartnerem przy szukaniu hipotez. Często zauważa korelacje, których człowiek nie wyłapałby w gąszczu wykresów: np. subtelny wzrost czasu odpowiedzi pojedynczego serwisu, który przekłada się na timeouty w innym komponencie.

Typowy mit: „AI sama znajdzie przyczynę regresji po deployu”. Rzeczywistość: pomoże posegregować dane i zasugerować kilka tropów, ale nadal trzeba kogoś, kto zna system i sprawdzi, co z tego ma sens.

Generowanie i utrzymywanie runbooków

Runbooki awaryjne często istnieją tylko w głowie starszych inżynierów. AI może pomóc to skodyfikować:

- na podstawie postmortemów i ticketów tworzyć pierwszą wersję runbooka dla konkretnego typu incydentu,

- aktualizować runbook po kolejnych incydentach, gdy zmieniają się narzędzia lub architektura,

- normalizować format – np. zawsze: „symptomy → możliwe przyczyny → komendy diagnostyczne → kroki naprawcze → kryteria zakończenia”.

Dobrą praktyką jest trzymanie runbooków jako kodu w repozytorium (np. Markdown) i traktowanie modelu jak „edytora technicznego”: generuje szkic na podstawie logów i opisów, a SRE robi review. Dzięki temu dokumentacja awaryjna nie gnije na Confluence w losowych formatach.

Asystent on-call i „pierwsza linia” wsparcia

Przy dyżurach on-call AI może być pierwszym miejscem, gdzie inżynier wrzuca:

- fragmenty logów,

- screeny z dashboardów,

- treści alertów z systemu monitoringu.

Z tego da się wygenerować:

- skrót diagnostyczny – jakie są najważniejsze symptomy,

- listę komend do odpalenia na klastrze/VM,

- podpowiedź, czy incydent wygląda na znany (porównanie z poprzednimi opisami incydentów).

W praktyce dobrze działa powiązanie asystenta z bazą wiedzy zespołu: playbookami, postmortemami, dokumentacją usług. Model może wtedy powiedzieć nie tylko „tu jest błąd 502”, ale też „w podobnym przypadku 3 miesiące temu pomogło zwiększenie limitu połączeń do bazy X”.

Kod jakościowy mimo AI – review, testy, standardy

Definiowanie „Definition of Done” pod AI

Jeśli w zespole używa się AI do generowania kodu, trzeba doprecyzować, co oznacza „gotowe”. Dobrze działa prosty zestaw zasad:

- każda zmiana zawiera testy adekwatne do ryzyka (jednostkowe, integracyjne lub kontraktowe),

- nie ma „niewyjaśnionych” fragmentów – autor rozumie każdy istotny blok, nawet jeśli powstał z AI,

- krytyczne ścieżki (płatności, autoryzacja, operacje idempotentne) nie przechodzą bez ludzkiego review,

- dołączony jest skrót decyzji technicznych: co zostało przyjęte z propozycji AI, a co odrzucone.

Mit, że „skoro kod jest z AI, to na pewno jest poprawny”, szybko kończy się technicznym długiem. Realnie: kod z AI ma inny rozkład błędów – mniej literówek, więcej subtelnych niezgodności z kontekstem biznesowym.

Style guide dla promptów technicznych

Tak jak zespoły mają style guide dla kodu, przy intensywnym użyciu AI warto spisać kilka prostych reguł dla promptów:

- zawsze podawaj wersję języka/frameworka (np. „Python 3.11, FastAPI 0.110”),

- opisuj kontekst domenowy w 1–3 zdaniach, zamiast wrzucać go w osobnym dokumencie,

- mów, czego nie chcesz – np. „bez zewnętrznych zależności poza X i Y”,

- proś o krótkie uzasadnienie, nie tylko o kod („wyjaśnij, dlaczego wybrałeś taki wzorzec”).

Ujednolicenie stylu promptów sprawia, że wyniki są stabilniejsze, a zespół łatwiej odtwarza czyjeś zapytania. To szczególnie przydatne przy przeglądzie MRa: można zobaczyć nie tylko kod, ale też z jaką intencją był generowany.

Testy jako „ground truth” dla modeli

Modele językowe generują przekonująco wyglądające odpowiedzi, ale testy są ostatecznym arbitrem. Dobry sposób pracy to:

- najpierw poprosić model o listę scenariuszy testowych w formie opisowej,

- uzupełnić/zmodyfikować tę listę według wiedzy biznesowej,

- poprosić o wygenerowanie kodu testów tylko dla zaakceptowanej listy,

- uruchomić testy i wykorzystać wyniki do kolejnej iteracji (np. „te dwa testy są flaky, popraw implementację”).

W ten sposób testy pełnią funkcję „szyny” ograniczającej fantazję modelu. Nawet jeśli kod produkcyjny był generowany przez AI, to przechodzi przez te same rygory jakościowe co kod pisany ręcznie.

Linting i reguły statycznej analizy z pomocą AI

Static analysis zwykle opiera się na sztywnych regułach. AI pozwala:

- proponować nowe reguły na bazie najczęstszych błędów w repozytorium,

- grupować powtarzające się ostrzeżenia i sugerować zmiany w architekturze (np. „tu stale łamiesz zasadę single responsibility”),

- automatycznie tworzyć PR-y naprawiające prostsze naruszenia reguł.

Zamiast ręcznie dopisywać dziesiątki reguł, można poprosić model: „na podstawie tych 100 ostrzeżeń SonarQube zaproponuj 5 ogólnych reguł, które zredukowałyby ich liczbę o połowę”. Efektem jest bardziej sensowne, kontekstowe podejście niż ślepe zwiększanie rygoru lintera.

Dokumentacja kodu i architektury bez wodolejstwa

Przy istniejącym kodzie AI dobrze radzi sobie z:

- generowaniem zwięzłych opisów modułów na podstawie ich publicznego API,

- tworzeniem prostych diagramów (C4, sekwencji) w ASCII/PlantUML,

- streszczaniem długich dokumentów decyzji architektonicznych (ADR) do formy „executive summary” dla nowych ludzi w zespole.

Trik polega na tym, aby ograniczyć input do małych, spójnych fragmentów: jeden moduł, jeden ADR, jedna usługa. Wrzucenie całego monolitu do promptu kończy się generycznym bełkotem. Lepiej pracować iteracyjnie, a potem ręcznie spinać fragmenty w większy obraz.

Katalogowanie i odnajdywanie „żywych” standardów

Standardy projektowe często żyją w kilku miejscach naraz: Confluence, README, wewnętrzne RFC. Model może zostać nakarmiony tymi dokumentami i pełnić rolę:

- „routera” – na pytanie „jak nazwać nową usługę w tym domenowym bounded context?” odsyła do właściwego fragmentu standardu,

- walidatora – sprawdza PR pod kątem zgodności z ustalonymi wzorcami,

- agregatora – proponuje aktualizację standardu, gdy widzi powtarzający się wzorzec, którego w nim brak.

To podejście działa lepiej niż utrzymywanie jednego, wielkiego dokumentu standardów. Zespół zadaje praktyczne pytania, a AI podpowiada konkretny paragraf i ewentualną interpretację pod bieżący przypadek.

Bezpieczeństwo, compliance i prywatność przy użyciu AI w pipeline’ach

Modele „w obrębie organizacji” vs SaaS – decyzja architektoniczna

Podstawowy dylemat: korzystać z publicznych API (SaaS) czy utrzymywać modele we własnej infrastrukturze. Różnica nie jest tylko kosztowa:

- SaaS daje lepsze modele „out of the box”, ale wymaga bardzo ostrego zarządzania danymi (anonimizacja, ograniczenia zakresu),

- self-hosted to większa kontrola i łatwiejszy compliance, ale też odpowiedzialność za aktualizacje, observability modelu i zużycie zasobów.

W wielu organizacjach rozsądnym etapem przejściowym jest hybryda: krytyczne dane (np. logi z PII, kod zawierający tajemnice handlowe) idą wyłącznie do modelu on-prem, a mniej wrażliwe zastosowania (refaktoryzacja helperów, generowanie dokumentacji) do SaaS, z jasnym podziałem w politykach.

Klasyfikacja i anonimizacja danych wejściowych

Zanim jakiekolwiek dane trafią do modelu, da się je przetworzyć automatycznie:

- prosty klasyfikator (również oparty na AI) oznacza dane jako: publiczne, wewnętrzne, poufne, ściśle tajne,

- moduł anonimizacji usuwa/zasłania PII – np. e-maile, numery telefonów, identyfikatory klientów,

- dla kategorii wyższych niż „wewnętrzne” przepływ do usług zewnętrznych jest blokowany.

Ten „pre-processor” może działać jako osobny krok w pipeline’ach CI/CD i narzędziach deweloperskich (np. plugin IDE). Zamiast wymagać od każdego, aby pamiętał o anonimizacji, proces jest wbudowany w narzędzia.

Skany bezpieczeństwa wspierane przez AI

Klasyczne skanery SAST/DAST generują mnóstwo false positives. AI można użyć do:

- priorytetyzacji wyników – która podatność jest realnie exploitable w kontekście aplikacji,

- grupowania podobnych findings i proponowania jednego, spójnego patcha,

- tłumaczenia wyników na język zrozumiały dla product ownerów (jakie ryzyko biznesowe, jakie skutki naruszenia).

Typowa praktyka: skaner bezpieczeństwa generuje raport JSON, a model dostaje zadanie „posegreguj te wyniki wg ryzyka i zaproponuj CRO/PO 3–5 zdań opisu per kategoria”. Zmniejsza to tarcie między bezpieczeństwem a delivery – nie trzeba za każdym razem ręcznie „tłumaczyć z security na biznes”.

Polityki wykorzystania AI jako kod

Zamiast pisać długie dokumenty polityk, można je reprezentować jako kod:

- reguły, które typy danych mogą trafić do jakiego modelu,

- mapowanie ról (dev, tester, SRE) na dostępne możliwości (np. generowanie kodu, dostęp do logów produkcyjnych),

- limity – np. maksymalny rozmiar promptu z produkcyjnymi logami.

Takie polityki można wymuszać w pipeline’ach (np. za pomocą customowych akcji w GitHub Actions czy GitLab CI). Gdy ktoś spróbuje przesłać do zewnętrznego modelu plik zawierający dane oznaczone jako poufne, job się wyłoży z czytelnym komunikatem. Polityka nie jest wtedy tylko slajdem na szkoleniu, ale realną barierą techniczną.

Śledzalność decyzji i „audit trail” dla AI

Przy użyciu AI w procesach wytwórczych audytorów interesuje nie tylko efekt (kod, konfiguracja), ale też to, co się działo po drodze. Warto:

Do kompletu polecam jeszcze: Najczęstsze błędy w konfiguracji chmury i jak je wykryć audytem — znajdziesz tam dodatkowe wskazówki.

- logować kluczowe interakcje z AI, zwłaszcza te, które wpływają na produkcję (generowanie migracji DB, zmian w IaC, reguł firewalla),

- przechowywać zestaw: prompt, odpowiedź, autor, timestamp, powiązany ticket/JIRA,

- mieć mechanizm szybkiego „replayu” – możliwość odtworzenia, jak powstała dana decyzja.

To ułatwia nie tylko audyty, lecz także retrospekcje techniczne: można sprawdzić, które sugestie AI są regularnie odrzucane i na tej podstawie dostroić prompt lub w ogóle wyłączyć dany typ zastosowania.

Ograniczanie ryzyka wycieku tajemnic z kodu

Generatory kodu lubią proponować przykłady z „twardymi” sekretami (API key, hasło do bazy). W drugą stronę – programiści potrafią przypadkiem wrzucić do promptu plik .env. Zabezpieczenia na kilku poziomach zmniejszają to ryzyko:

- pre-commit hooki wyszukujące potencjalne sekrety (regexy, skanery typu trufflehog) i blokujące ich dodanie do repo,

- filtry w pluginach IDE, które nie pozwalają przesłać do modelu fragmentów dopasowanych do wzorców sekretów,

- walidacja w pipeline’ach – jeśli wygenerowany kod zawiera coś, co wygląda na sekret, build się zatrzymuje.

Mit: „tajemnice wylecą przez AI, jeśli tylko zaczniemy go używać”. Realny problem jest zwykle odwrotny: tajemnice i tak są w kodzie, a użycie AI tylko uwidacznia brak higieny. Uporządkowanie tego przy okazji wdrażania AI bywa nieprzyjemne, ale długofalowo poprawia bezpieczeństwo.

Najczęściej zadawane pytania (FAQ)

Czy AI naprawdę zabierze pracę programistom i zespołom DevOps?

AI nie „zjada” etatów, tylko zmienia rozkład zadań. Z prostego klepania powtarzalnego kodu czy ręcznego składania pipeline’ów rola przesuwa się w stronę projektowania rozwiązań, oceny jakości i podejmowania decyzji architektonicznych. Narzędzia generatywne robią brudną, powtarzalną robotę, ale nie rozumieją kontekstu biznesowego ani długofalowych konsekwencji technicznych.

Mit jest taki, że „AI zastąpi programistę”. Rzeczywistość: AI wchodzi w miejsce, gdzie i tak większość osób się nudziła – boilerplate, szablony, drobne refaktoryzacje. Przewagę zyskują ci, którzy potrafią prowadzić model (dawać mu właściwy kontekst) i krytycznie oceniać wynik, a nie ci, którzy udają, że nic się nie zmieniło.

Jakich zadań programistów i DevOps najbardziej opłaca się automatyzować z pomocą AI?

Największy zwrot dają czynności powtarzalne, szablonowe i niskiego ryzyka. U programistów to zwykle: generowanie szkieletów klas i endpointów, proste testy jednostkowe, adaptery HTTP, konwertery DTO oraz uzupełnianie dokumentacji technicznej. AI dobrze radzi sobie tam, gdzie wynik łatwo porównać z istniejącymi wzorcami w projekcie.

W DevOps i Platform Engineering sens mają m.in. szablony pipeline’ów CI/CD, dodawanie prostych jobów „na wzór”, generowanie podstawowych manifestów IaC, streszczanie logów i grupowanie powtarzających się alertów. W tych obszarach człowiek dalej podejmuje decyzje, ale zamiast zaczynać od zera, startuje od szkicu, który tylko doprecyzowuje i testuje.

Jak odróżnić „gadżet AI” od narzędzia, które realnie przyspiesza pracę?

Podstawowy test: po kilku tygodniach używania jesteś w stanie pokazać liczby czy tylko wrażenia. Jeśli zespół potrafi wskazać poprawę w twardych metrykach, takich jak czas code review, średnia długość życia PR, czas przygotowania nowego pipeline’u czy MTTR dla incydentów, to znaczy, że narzędzie wpasowało się w proces.

Gadżet rozpoznasz po tym, że jest „fajny do poklikania”, ale nie integruje się sensownie z IDE, Git, CI/CD i nie uwzględnia kontekstu waszego repo. Częsty scenariusz: wiele eksperymentów, zero trwałych zmian w workflow i brak artefaktów, które inni w zespole mogą powielić. Rzeczywistość jest taka, że bez zdefiniowanego celu i KPI nawet dobre narzędzie zmienia się w zabawkę do sandboxu.

Jak bezpiecznie zacząć korzystać z AI w projekcie developerskim lub DevOps?

Najpierw zbierz listę powtarzalnych zadań z 1–2 tygodni pracy zespołu, a potem wybierz 3–5 kandydatów: częste, szablonowe, łatwe do zmierzenia i o niskim ryzyku biznesowym. Dobry start to generowanie szkieletów klas/modułów, prostych testów jednostkowych, podstawowych pipeline’ów oraz drobny refactoring (skracanie funkcji, usuwanie duplikacji).

Następny krok to jasne zasady: które obszary są „no-go” dla generacji (np. krytyczne fragmenty bezpieczeństwa), kto musi zaakceptować zmiany wygenerowane przez AI i jakie testy są obowiązkowe. Mit: „wrzucimy AI do procesu i samo się ułoży”. Rzeczywistość: bez reguł i kryteriów akceptacji łatwo wprowadzić do kodu więcej hałasu niż wartości.

Jakie są największe ryzyka i ograniczenia korzystania z AI przez programistów i DevOps?

Najpoważniejszym problemem są tzw. halucynacje: wymyślone klasy, metody, flagi CLI czy opcje konfiguracji, które brzmią wiarygodnie, ale nie istnieją. Model działa na prawdopodobieństwie, więc potrafi wygenerować bardzo przekonującą bzdurę – poprawną językowo, lecz technicznie błędną. Im mniej kontekstu mu podasz (np. tylko fragment kodu bez związanych plików), tym bardziej losowy będzie efekt.

Odpowiedzialność za kod i infrastrukturę nie znika, tylko zostaje po stronie człowieka. AI jest jak kalkulator, który potrafi też „zaokrąglić po swojemu”. Dlatego wymagane są: code review z udziałem ludzi, obowiązkowe testy dla zmian robionych z pomocą AI i świadome unikanie automatycznej generacji w obszarach wysokiego ryzyka (kryptografia, kluczowe elementy bezpieczeństwa, złożona logika biznesowa).

Jak mierzyć, czy AI faktycznie zwiększa produktywność zespołu, a nie marnuje czas?

Zamiast pytać „czy czujemy, że jest szybciej?”, lepiej ustalić konkretne metryki przed wdrożeniem AI. Przykładowo: średni czas przygotowania nowego pipeline’u CI/CD, czas od otwarcia PR do zmergowania, średni czas diagnozy typowego incydentu, liczba powtarzalnych alertów przetwarzanych ręcznie. Dopiero do takich punktów można przyłożyć „linijkę” i porównać stan przed i po.

Jeśli po sprintach z eksperymentami nie ma żadnych powtarzalnych snippetów, szablonów czy usprawnionych procedur, a jedynym efektem jest „wiemy, że AI coś tam umie”, to znak, że brakuje celu. Rzeczywisty zysk widać wtedy, gdy w backlogu zaczyna ubywać zadań typu „kolejny podobny endpoint/pipeline/log review”, bo zespół ma już gotowe wzorce wspierane przez AI.

Jakie zadania są złym kandydatem na automatyzację z AI na początku wdrożenia?

Słabym wyborem na start są obszary, gdzie błąd może być bardzo kosztowny lub trudny do zauważenia. Chodzi m.in. o kryptografię, krytyczne elementy bezpieczeństwa aplikacji, złożone decyzje architektoniczne w systemach o wysokim ryzyku biznesowym czy kluczową logikę płatności. Tam AI może służyć co najwyżej jako narzędzie do researchu i inspiracji, a nie jako „autopilot” do generowania gotowych rozwiązań.

Mit: „skoro AI pisze kod, to niech zrobi też te najtrudniejsze kawałki”. Rzeczywistość jest odwrotna – największy sens ma w prostych, powtarzalnych zadaniach, gdzie wynik łatwo sprawdzić i porównać ze znanymi wzorcami. Im bardziej skomplikowany, wielowątkowy i ryzykowny obszar, tym bardziej AI powinno być co najwyżej asystentem, a nie autorem zmian.

Co warto zapamiętać

- AI nie zabiera pracy programistom i DevOps, tylko przesuwa środek ciężkości z ręcznego „klepania” na projektowanie rozwiązań, decyzje architektoniczne, ocenę jakości i łączenie narzędzi w spójne procesy.

- Realna przewaga jest po stronie osób, które świadomie korzystają z AI – mitem jest, że „ignorując AI, bronisz swojej roli”; w praktyce oddajesz przewagę tym, którzy potrafią używać go jak kolejnego, dobrze opanowanego narzędzia (IDE, linters, CI/CD).

- Największy sens ma AI tam, gdzie jest powtarzalność i hałas: generowanie szkieletów kodu, prostych testów, szablonów pipeline’ów, refaktoryzacja drobnicy, wstępne code review oraz streszczanie logów i alertów – człowiek dalej decyduje, ale „brudna robota” jest odciążona.

- Kluczowa różnica między „gadżetem” a narzędziem to integracja z istniejącym stackiem (IDE, Git, CI/CD), możliwość podania kontekstu projektu, sensowny model uprawnień i mierzalne efekty; jeśli po kilku tygodniach nie da się pokazać poprawy na metrykach, to znak, że używane jest tylko „fajne UI do modelu”.

- Modele generatywne z natury halucynują i mogą bardzo przekonująco podawać fałszywe odpowiedzi, więc odpowiedzialność za kod i infrastrukturę zostaje po stronie człowieka; zespół musi jasno ustalić, kto zatwierdza zmiany z AI, jakie testy są obowiązkowe i które obszary są wyłączone z automatycznej generacji.